Molte tecnologie, prima di diffondersi in modo capillare, sono rimaste confinate per molti anni nell’ambito ristretto dei laboratori di ricerca. La transizione ecologica potrebbe favorire la diffusione di nuovi materiali, oggi sconosciuti al grande pubblico, che potrebbero avere un profondo impatto sul futuro dell’economia.

Negli anni ’70 del secolo scorso, l’attenzione dell’opinione pubblica era tutta concentrata su quella che è passata alla storia come la prima grande crisi petrolifera (1973). Gli italiani scoprirono le “domeniche a piedi” e quell’episodio segnò l’inizio del declino di quella che, nella storia dell’economia, si potrebbe definire l’età del petrolio.

Il petrolio aveva rappresentato, fino a quel momento, uno degli elementi fondamentali dello sviluppo economico, fornendo energia abbondante e a buon mercato. Aveva consentito, almeno nei Paesi più ricchi, una rapida “motorizzazione di massa” e la produzione su larga scala di materie plastiche e di altri prodotti chimici. Ovviamente non mancavano i problemi, primo fra tutti quello dell’inquinamento ambientale. Allora il grande pubblico ignorava il problema del riscaldamento globale che era oggetto di dibattito solo tra una ristretta cerchia di scienziati.

Mentre l’opinione pubblica era distratta dai problemi della crisi petrolifera, l’elettronica si stava avviando verso una silente e rapida rivoluzione. La grande innovazione era rappresentata dall’uso crescente di circuiti integrati e microprocessori che erano stati inventati negli anni ‘60, per scopi principalmente militari, utilizzando le nascenti tecnologie basate sul silicio. Proprio mentre stava declinando l’età del petrolio, stava sorgendo l’età del silicio che ancora caratterizza i nostri tempi.

Negli anni ‘70 la cosiddetta elettronica di consumo si limitava a ben poca cosa (radio, giradischi – inclusi i mitici mangiadischi – e televisori), ma le cose stavano per cambiare: erano in arrivo nuovi dispositivi elettronici che avrebbero invaso rapidamente il mercato.

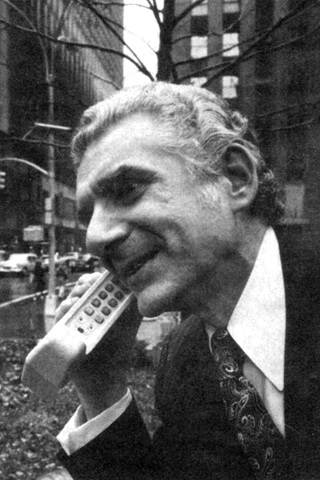

Nel 1973 i laboratori Motorola sperimentarono il primo telefono cellulare (una specie di “mattone” che aveva una autonomia di soli 30 minuti e impiegava 10 ore per ricaricarsi).

Dieci anni dopo, Motorola metteva sul mercato il primo cellulare commerciale, il modello DynaTac 8000X che veniva venduto al modico prezzo di 3.995 US$. Sempre all’inizio degli anni ‘80, IBM presentò il suo primo personal computer. Era solo l’inizio di uno sviluppo sfolgorante che avrebbe prodotto il boom dell’informatica e delle telecomunicazioni, con i dispositivi elettronici diventati sempre più pervasivi.

Oggi, quasi 50 anni dopo quel 1973 che segnò il passaggio dall’età del petrolio a quella del silicio, l’opinione pubblica è tutta presa dalle preoccupazioni per l’ennesima crisi energetica, per la guerra in corso in Europa e per le conseguenze non ancora tutte risolte della pandemia. Intanto la ricerca va avanti e anche l’età del silicio potrebbe avviarsi verso il tramonto.

Attualmente il silicio è di gran lunga il materiale più utilizzato per la costruzione di dispositivi elettronici. Germanio ed arseniuro di gallio coprono una fetta minoritaria del mercato che a livello mondiale ammonta a circa 600 miliardi di US$.

I dispositivi elettronici fanno ormai parte del nostro modo di vivere, ma sono diventati anche degli importanti dissipatori di energia. Ci sono varie stime che ci dicono che l’uso intensivo di programmi e applicazioni (incluso questo mio piccolo blog) che girano su computer e cellulari producono un consumo energetico (con conseguente emissione di CO2) confrontabile con quello di una nazione di grandi dimensioni (ad esempio, il Giappone). Ridurre i consumi dei dispositivi elettronici è ormai indispensabile e questo ha stimolato nuovi filoni di ricerca in molti laboratori in giro per il mondo.

Per ridurre le emissioni di CO2 potremmo pensare di aumentare l’uso del solare fotovoltaico, ma anche in questo caso abbiamo a che fare con dispositivi elettronici. Le cellule fotovoltaiche riescono a trasformare in energia elettrica solo una parte dell’energia che assorbono dai raggi del sole e la ricerca è molto attiva per trovare soluzioni che siano, contemporaneamente, meno costose e più efficienti.

Qui di seguito vi presento 2 esempi di ricerche particolarmente interessanti, tratti dal sito di informazioni MIT News.

Un settore di crescente importanza per l’elettronica è quello dei mezzi di trasporto, con particolare riferimento all’auto elettrica. Oltre a monitorare il mezzo e a rendere più confortevole l’esperienza di guida, l’elettronica svolge il compito fondamentale di gestire il trasferimento di potenza dall’esterno verso la batteria e tra la batteria ed il motore.

Il circuito elettronico interposto tra batteria e motore deve poter gestire, nei momenti di picco, potenze che superano i 300 kW (100 volte la potenza di picco che viene gestita in una comune abitazione). Analoghi picchi di potenza devono essere gestiti nei caricatori a carica ultra-veloce (quelli che dovremo diffusamente installare almeno in autostrada se non vogliamo intasare le corsie di auto elettriche in panne a causa della batteria scarica).

Anche se i circuiti elettronici di potenza sono progettati per ridurre al minimo possibile le perdite legate al passaggio della corrente, è evidente che quando vengono gestite potenze così elevate la quantità di energia dissipata sotto forma di calore sarà comunque notevole. Se questo calore non viene dissipato efficacemente, il circuito si surriscalda e finisce fatalmente per rompersi.

Il silicio non possiede una conducibilità termica particolarmente elevata e questo è un grosso problema per i progettisti di componentistica per auto elettriche. Un sostituto del silicio che viene già utilizzato su vasta scala è il SiC (carburo di silicio), un semiconduttore che rappresenta un compromesso non ottimale perché ha una conducibilità termica che è pari a 3 volte quella del silicio, ma ha caratteristiche elettriche peggiori che provocano un aumento dell’energia dissipata.

Recentemente il Massachusetts Institute of Technology (MIT) ha annunciato i risultati di uno studio preliminare dedicato all’arseniuro di boro, un nuovo materiale semiconduttore che, oltre ad avere una conducibilità termica pari a 10 volte quella del silicio, possiede caratteristiche elettriche decisamente superiori rispetto al silicio, soprattutto per quanto riguarda la mobilità delle lacune (uno dei portatori di carica che contribuiscono al passaggio della corrente nei materiali semiconduttori).

L’arseniuro di boro potrebbe essere una scelta decisamente migliore rispetto al silicio. Oltre a ridurre le dimensioni ed il peso dei dispositivi elettronici di potenza, un tale materiale potrebbe migliorare l’efficienza nell’utilizzo dell’energia utilizzata per far funzionare le auto elettriche. Purtroppo, almeno fino ad oggi, non disponiamo di metodi industriali adatti per produrre arseniuro di boro su vasta scala, garantendo buone caratteristiche di omogeneità. Ci sono ancora molti problemi da risolvere, ma la strada sembra promettente e potrebbe portare in tempi relativamente brevi (5-10 anni) ad una profonda innovazione nel settore dell’elettronica di potenza per uso automobilistico. Il condizionale è d’obbligo perché non è la prima volta che vengono annunciate interessanti alternative al silicio che, alla fine, si rivelano meno attraenti di quanto fosse stato inizialmente pensato.

Un altro recente annuncio dell’MIT fa il punto sullo sviluppo delle celle fotovoltaiche basate sulle cosiddette perovskiti, nome che viene dato ad una ampia famiglia di materiali che hanno una struttura cristallina simile alla Perovskite, un minerale naturale formato da ossido di calcio e titanio (CaTiO3). Nel corso degli ultimi 10 anni è stato osservato un rapido aumento del rendimento delle celle fotovoltaiche basate su perovskiti (in particolare, quelle ibride che combinano composti organici ed alogenuri di piombo). Tali celle sono molto più semplici da costruire ed economiche rispetto alle celle fotovoltaiche tradizionali basate sul silicio (che garantiscono un rendimento elevato solo se il silicio è molto puro). C’è ancora un ampio margine di sviluppo perché le possibili configurazioni a livello atomico di questi materiali sono numerosissime. Pensate che, per capirci di più, gli scienziati stanno adottando metodi di intelligenza artificiale che – combinati con raffinati sistemi di calcolo quantistico – potranno aiutarli a selezionare a priori le configurazioni più promettenti da sperimentare in laboratorio.

Purtroppo le perovskiti non garantiscono una sufficiente stabilità nel corso del tempo. Attualmente le migliori celle fotovoltaiche al silicio, dopo 25 anni di lavoro, forniscono un rendimento pari al 90% del valore iniziale (purché vi ricordiate di pulire regolarmente i pannelli solari rimuovendo la polvere e lo sporco che si deposita sulla loro superficie). Nel caso delle celle a perovskite si osserva un degrado naturale del cristallo, con conseguente calo delle prestazioni, nell’arco di pochi anni. Troppo rapido per poterne fare un uso commerciale.

Forse gli scienziati sono riusciti a capire le ragioni di questo fenomeno e ipotizzano di attivare adeguate procedure per prevenirlo (un fenomeno simile avveniva nei prototipi iniziali degli organic light-emitting diodes (OLED) che oggi troviamo montati nei nostri televisori).

In conclusione, si vedono all’orizzonte materiali alternativi al silicio che potrebbero portare ad un miglioramento – sia in termini di costi che di prestazioni – sia delle auto elettriche che dei pannelli fotovoltaici. La transizione ecologica potrebbe ridurre l’importanza del silicio per dare spazio a materiali innovativi che, oggi, sono ancora sconosciuti al grande pubblico.

Lascia un commento