Lo sviluppo tumultuoso dell’intelligenza artificiale ha acceso un ampio dibattito che appassiona l’opinione pubblica. Oggi molti si pongono la domanda: “è ancora possibile distinguere il vero dal falso?“. In altre parole, ha ancora senso ispirarsi al motto galileiano “Provare e riprovare“? La risposta è sì purché non rinunciamo ad utilizzare la nostra intelligenza naturale affidandoci in modo passivo all’intelligenza artificiale (che può aiutarci a migliorare considerevolmente la nostra capacità di fare ricerca, ma deve essere gestita con competenza).

“Provare (il vero) e riprovare (il falso)” – come ci ha insegnato Galileo – è la base del cosiddetto “metodo scientifico“, ma talvolta abbiamo la sensazione che separare il vero dal falso diventi sempre più difficile, soprattutto quando ci troviamo di fronte ai falsi sempre più sofisticati che chiunque può produrre utilizzando l’intelligenza artificiale (IA).

Sorge spontanea la domanda: “in un mondo dominato dall’intelligenza artificiale ha ancora senso domandarsi se una informazione sia vera o falsa o c’è il rischio che avremo sempre più a che fare con una sorta di verità artificiale del tutto sconnessa con la realtà?”.

Rispondere a questa domanda non è semplice, anche perché i concetti di “vero e falso” possono assumere sfumature molto diverse a seconda del contesto nel quale sono utilizzati. Non ho la presunzione di affrontare il tema nella sua generalità. Qui mi limiterò a discutere di “vero e falso” nell’ambito scientifico cercando di mettere in evidenza sia i vantaggi che i rischi legati all’uso sempre più intensivo dell’intelligenza artificiale.

Prima di discutere dei rischi vorrei parlare dei benefici, ricordando che diversi metodi basati sull’intelligenza artificiale fanno ormai parte del “bagaglio degli attrezzi” utilizzato dagli scienziati. A differenza di quanto sta accadendo per l’opinione pubblica (e per gli analisti finanziari) l’IA non è la “novità del momento“. In ambito scientifico l’intelligenza artificiale è già qualcosa di consolidato ed acquisito, anche se ci sono ancora enormi margini di sviluppo per le sue applicazioni. Chiunque segua la letteratura scientifica avrà notato come – ormai da alcuni anni – appaiano con crescente frequenza pubblicazioni nelle quali si cita l’IA come uno dei metodi utilizzati per lo svolgimento della ricerca.

Nel corso dell’ultimo decennio le applicazioni basate sull’intelligenza artificiale sono state sempre più utilizzate per programmare esperimenti che devono essere ripetuti molte volte usando configurazioni diverse (ad esempio, nella ricerca di nuovi farmaci), nella stabilizzazione di dispositivi sperimentali particolarmente complessi (ad esempio, nelle macchine per la fusione a confinamento magnetico) e nell’analisi di basi dati di grandissime dimensioni (i cosiddetti big data).

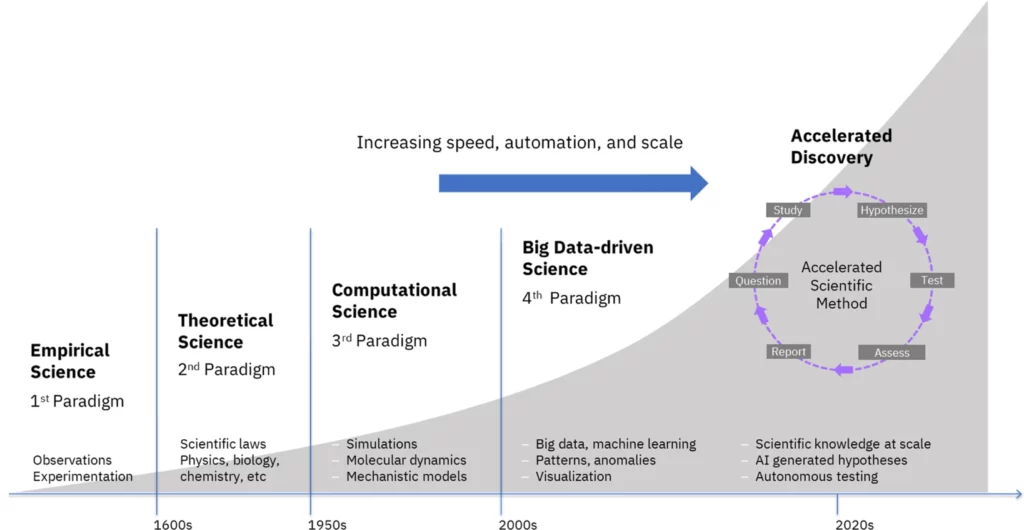

In una prospettiva di medio termine c’è chi ipotizza che l’intelligenza artificiale possa attivare un vero e proprio salto di paradigma perché potrà automatizzare (accelerandolo enormemente) l’intero ciclo che porta a nuove scoperte scientifiche:

Qui di seguito troverete il link ad alcune pubblicazioni che illustrano lo stato attuale e le prospettive di sviluppo delle applicazioni dell’IA in alcuni importanti settori di ricerca:

- Artificial intelligence: A powerful paradigm for scientific research

- Artificial intelligence for materials design

- Accelerating materials discovery using artificial intelligence, high performance computing and robotics

- Artificial Intelligence workflow for catalyst design and optimization

- How AI and ML will affect physics

- Avoiding fusion plasma tearing instability with deep reinforcement learning

- AI is helping astronomers make new discoveries and learn about the universe faster than ever before

- Opportunities and challenges in application of artificial intelligence in pharmacology

- AI for life: Trends in artificial intelligence for biotechnology

I vantaggi dell’IA applicata all’ambito scientifico sono innegabili e – a differenza di quanto sta accadendo in altri settori – la grande maggioranza degli scienziati non vede l’intelligenza artificiale come un pericoloso concorrente che potrebbe privarli del loro lavoro. La comunità scientifica è pronta a sfruttare le nuove opportunità offerte dall’IA per portare avanti esperimenti sempre più sofisticati.

Ciò non toglie che – anche in ambito scientifico – l’uso sempre più intensivo dell’IA possa generare situazioni potenzialmente pericolose. Prima di approfondire questo tema è necessario ricordare quali sono le basi del cosiddetto “metodo scientifico“, evidenziando quei passaggi dove un uso inappropriato dei metodi di IA potrebbe generare criticità.

Gli scienziati – a differenza dei teologi – non hanno a che fare (o meglio, non dovrebbero mai avere a che fare!) con dogmi e verità “rivelate” e non dispongono neppure di “sacri testi” a cui fare riferimento. Di fronte ad un fenomeno naturale, gli scienziati non possono fare altro che osservarlo, misurando con la migliore accuratezza possibile tutte le grandezze che lo caratterizzano.

Dopo che è stato acquisito un numero sufficiente di dati sperimentali si passa alla loro interpretazione che viene fatta sulla base di un modello che ci aiuta a comprendere le cause che hanno generato il fenomeno osservato e ci fornisce previsioni sulla sua futura evoluzione.

Talvolta le nuove scoperte scientifiche sono stimolate dall’osservazione di un fenomeno naturale sconosciuto. In altri casi si può partire da una intuizione che porta alla formulazione di ipotesi teoriche che – successivamente – vengono sottoposte ad un test sperimentale: ad esempio, alcune dei risultati più significativi della ricerca fisica ottenuti nel corso degli ultimi 2 decenni sono il frutto di previsioni teoriche fatte molti decenni prima. Mi riferisco – in particolare alla condensazione di Bose-Einstein, al bosone di Higgs e alle onde gravitazionali.

Scritto così, sembra che il metodo scientifico sia tutto sommato semplice e che possa essere sempre applicato con rigore e tempestività. Purtroppo le cose non stanno esattamente in questo modo. Per farvi capire quali sono “i rischi del mestiere” vi racconterò due episodi importanti della storia della fisica: gli studi astronomici che hanno coinciso con la nascita della Scienza moderna ed un caso (probabile) di falso scientifico (o quantomeno di uso disinvolto dei protocolli sperimentali) che sta dietro ad una storia di successo (premiata addirittura con il premio Nobel per la fisica).

Partiamo dal lungo e travagliato dibattito scientifico (filosofico e religioso) che ha portato all’abbandono del modello astronomico aristotelico-tolemaico che poneva la Terra al centro dell’Universo.

Il primo a mettere in discussione il modello tolemaico fu l’astronomo polacco Niccolò Copernico che esplicitò per la prima volta la sua ipotesi eliocentrica nel 1515, pubblicando poi un trattato esteso dal titolo De revolutionibus orbium coelestium, pubblicato nel 1543, anno della sua morte.

Copernico effettuò le sue osservazioni ad occhio nudo e benché la sua ipotesi fosse corretta, non disponeva di dati abbastanza precisi e dettagliati per convincere chi lo leggeva della validità del suo modello.

Una prima rivoluzione avvenne quando nel 1610 Galileo Galilei pubblicò il suo Sidereus Nuncius nel quale descriveva le osservazioni astronomiche fatte con il suo nuovo cannocchiale. Galileo non fu l’inventore del cannocchiale (la cui origine si deve ad ottici olandesi), ma introdusse alcuni perfezionamenti essenziali sia nella costruzione delle lenti che nella configurazione dell’ottica e – soprattutto – dimostrò per primo l’utilità dello strumento per le osservazioni astronomiche.

Grazie ai suoi cannocchiali Galileo evidenziò una serie di dati astronomici mai osservati prima che – pur non dimostrando in modo inconfutabile la validità del modello copernicano – mettevano fortemente in crisi il vecchio modello aristotelico-tolemaico.

Sappiamo che le conclusioni raggiunte da Galileo gli attirarono le ire dell’Inquisizione, istigata anche da alcuni suoi colleghi accademici “tradizionalisti” che rifiutavano l’approccio sperimentale da lui proposto. Si racconta che uno dei suoi più accaniti avversari si rifiutò addirittura di osservare il cielo stellato attraverso il cannocchiale di Galileo (fu una sorta di “Don’t look up” di altri tempi!).

Alla fine – per salvare la pelle – Galileo fu costretto all’abiura e il Sidereus Nuncius finì tra i libri messi all’indice. La Chiesa Cattolica assunse una posizione rigorosamente contraria alla visione copernicana che fu mantenuta fino al 1757, anno in cui finalmente accettò il modello eliocentrico.

Ovviamente la comunità scientifica non attese le decisioni della Chiesa Cattolica per arrivare ad esprimere la sua posizione. Grazie al lavoro di grandi scienziati come Galileo, Keplero e Newton si arrivò non solo ad una descrizione qualitativa del modello eliocentrico, ma anche alla comprensioni delle leggi fisiche che lo governano. Il trattato Philosophiae Naturalis Principia Mathematica pubblicato da Isaac Newton nel 1687 poneva definitivamente fine al modello aristotelico-tolemaico.

Questo lungo esempio mette in evidenza alcuni punti importanti:

- Lo sviluppo di nuovi strumenti (come il cannocchiale galileiano che consentì di aumentare la quantità e la qualità dei dati sperimentali) porta inevitabilmente ad un miglioramento dei nostri livelli di conoscenza. Scienza e tecnologia sono intimamente connesse perché lo sviluppo della scienza favorisce la nascita di nuove soluzioni tecnologiche e viceversa.

- I modelli teorici sono espressi spesso (ma non necessariamente) sotto forma di equazioni matematiche. Grazie ad essi possiamo comprendere le cause che sono alla base dei fenomeni osservati (nell’esempio fatto precedentemente il moto dei pianeti è governato dalla forza di attrazione gravitazionale descritta – per la prima volta – da Newton). Inoltre i modelli teorici ci consentono di fare previsioni rispetto a quella che sarà l’evoluzione futura dei sistemi che stiamo osservando.

- Paradossalmente anche modelli sbagliati (come quello tolemaico) possono essere utilizzati per formulare previsioni, sia pure non accuratissime. Per secoli l’Umanità ha previsto congiunzioni astronomiche ed eclissi basandosi sul modello di Tolomeo che metteva la Terra al centro dell’universo. I calcoli fatti col modello tolemaico erano molto più complicati rispetto a quelli basati sul sistema copernicano, ma comunque funzionavano. Quindi anche se un modello fornisce previsioni azzeccate non vuol dire necessariamente che sia basato su ipotesi vere.

- Ci sono voluti circa 150 anni prima che Newton concludesse idealmente il lavoro avviato dall’intuizione di Copernico. Come abbiamo visto durante la recente pandemia di Covid-19 il consenso della comunità scientifica richiede tempo per essere costruito. Il consenso si consolida anche dimostrando che – dati alla mano – alcune ipotesi fatte da altri scienziati sono sbagliate. Per fare questo serve tempo e serve un confronto anche serrato tra ipotesi che possono essere contrastanti. La cosa importante è che tale confronto avvenga nelle sedi scientifiche deputate e non nei talk-show televisivi come – purtroppo – ci è capitato talvolta di vedere durante la pandemia.

- Notate che gli scienziati non parlano di “verità“, ma preferiscono usare l’espressione “consenso“. Il “consenso” non è per sua natura immutabile e può essere rivisto o aggiornato, ma solo se ci sono evidenze sperimentali che giustifichino tale revisione. Non abbiamo quindi a che fare con una “verità assoluta” così come potrebbe essere intesa in senso religioso o filosofico, ma con il “miglior livello possibile di conoscenza compatibile con le osservazioni sperimentali che siamo in grado di fare“. Ad esempio, nel caso del riscaldamento globale c’è un ampio consenso tra i climatologi che l’aumento delle quantità di anidride carbonica presente nell’atmosfera abbia origini dominate da effetti antropici. Qualcuno potrà dire di non essere d’accordo con questa idea, ma se volesse convincere la comunità scientifica dovrebbe portare prove adeguate a sostegno della sua tesi. Il dissenso di un singolo scienziato – non accompagnato da evidenze sperimentali che lo sostengano – non ha alcuna rilevanza.

- Talvolta sentiamo qualcuno affermare che bisogna “credere nella scienza“. La scienza (quella vera) non ha bisogno di una adesione basata sulla fede (che riguarda altre dimensioni umane, prima fra tutte quella religiosa). Il consenso scientifico è il faticoso risultato di un processo basato sull’acquisizione di prove sperimentali, sull’analisi dei dati e sul confronto di idee che possono essere anche molto diverse. Dobbiamo avere fiducia nella scienza e gli scienziati di devono meritare tale fiducia agendo in modo corretto, trasparente e rigoroso. Tuttavia, dobbiamo sempre ricordare che la scienza non è una sorta di “religione laica” e non richiede atti di fede.

- A priori nessuno può escludere che prima o poi anche il modello elaborato da Newton possa essere messo in discussione. Anzi – in realtà – questo è già accaduto perché quando Albert Einstein sviluppò la sua teoria sulla relatività generale dimostrò che questa spiegava alcuni dettagli del moto del pianeta Mercurio (in particolare, il moto di precessione del suo perielio) che non venivano ben descritti dai calcoli basati sulla teoria newtoniana. Il lavoro di Einstein estese le conclusioni raggiunte da Newton, ma non minò le basi su cui erano state fondate.

- Paradossalmente qualcuno potrebbe ipotizzare che siccome il “consenso scientifico” non è immutabile allora non possiamo escludere che – prima o poi – potremmo tornare al vecchio modello tolemaico. Questa è una enorme sciocchezza perché non ci sono dubbi sul fatto che la Terra non sia posta al centro dell’Universo. Ripeto, chiunque può sollevare dubbi su qualsiasi idea scientifica, ma i dubbi devono essere supportati da evidenze sperimentali verificabili.

La seconda storia che vi voglio raccontare è quella di Robert Andrews Millikan, premio Nobel per la Fisica del 1923. Il prof. Millikan è ricordato per aver misurato per la prima volta la carica dell’elettrone (e per altri studi che riguardano l’effetto fotoelettrico). In particolare, qui mi preme ricordare l’esperimento che gli permise di determinare la carica dell’elettrone. Si tratta di un esperimento concettualmente semplice, ma piuttosto complicato dal punto di vista della realizzazione pratica (almeno ai tempi di Millikan quando gli sperimentatori non disponevano di laser, telecamere e sistemi di acquisizione delle immagini). Non mi dilungo sui dettagli. Il punto essenziale è che – secondo le accuse che gli vennero rivolte da alcuni suoi contemporanei – invece di considerare tutti i dati prodotti dai suoi esperimenti sembra che il prof. Millikan scegliesse solo i dati che considerava a priori “corretti”, scartando in modo del tutto arbitrario quelli che non tornavano con le sue aspettative.

Millikan scrisse due articoli in cui illustrava i suoi esperimenti dedicati alla misura della carica dell’elettrone. Nel primo articolo ammise candidamente di aver scartato alcuni dati “incongrui” (ma non chiarì perché li riteneva tali), mentre nel secondo articolo dichiarò di non aver scartato alcun dato. Alcuni ritengono che abbia pesantemente barato. Altri sono più indulgenti e parlarono di errori veniali e comunque “non determinanti“.

Sta di fatto che Millikan determinò un valore della carica dell’elettrone molto vicino al miglior dato oggi disponibile. Tuttavia – come dimostrato da analisi postume – il margine di indeterminazione delle sue misure è troppo piccolo rispetto a quanto ci potremmo aspettare tenuto conto delle caratteristiche degli strumenti disponibili ai suoi tempi.

C’è il forte sospetto che il prof. Millikan abbia fatto quello che in inglese si chiama “cherry picking” (in italiano si potrebbe tradurre liberamente con “scegliere fior da fiore“). Quando si agisce in questo modo c’è il rischio di scegliere solo i dati che corrispondono ad una ipotesi preconcetta e non necessariamente vera. A tutti gli effetti il “cherry picking” è una pratica inappropriata classificabile come un vero e proprio falso.

I casi di “cherry picking” presenti nella letteratura scientifica sono numerosi. Un esempio recente – molto popolare tra i negazionisti del riscaldamento globale – è stato discusso in un post precedente.

Nel caso specifico del Prof. Millikan possiamo dire che se fu un falso, fu comunque un falso di successo perché il risultato che pubblicò era incredibilmente accurato e fu premiato con il premio Nobel.

Vi ho parlato di questa storia non per riproporre vecchie polemiche, ma per mettere in evidenza quanto sia importante garantire l’integrità dei dati sperimentali. In un esperimento può succedere di dover scartare alcuni dati che siano stati alterati da una interferenza di origine esterna. Ma questo deve essere fatto sulla base di rigidi protocolli e non può essere affidato alla scelta arbitraria dello sperimentatore.

Dopo questa lunga digressione nella storia della fisica abbiamo gli elementi sufficienti per capire quali siano le possibili criticità legate ad un uso inappropriato dell’intelligenza artificiale in ambito scientifico.

Il caso più ovvio è quello di utilizzare l’IA per generare dati sperimentali fasulli o addirittura articoli che – a prima vista – potrebbero apparire come veri, ma che in realtà sono pura invenzione. Oggi qualsiasi fanatico terrapiattista potrebbe produrre pseudo-articoli scientifici per sostenere le sue idee (qualcosa del genere è già accaduto durante la pandemia di Covid-19 con alcune pubblicazioni fake ispirate dal movimento no-vax).

Quello dei dati sperimentali fasulli e delle pubblicazioni scientifiche di fantasia è un problema concreto, ma non particolarmente grave perché la comunità scientifica ha tutti gli strumenti necessari per smascherare iniziative di tale tipo. Ogni tanto succede che appaiano – anche su giornali scientifici ritenuti di buon livello – articoli che presentano risultati che alla fine si rivelano sbagliati (qualche volta a causa di errori grossolani fatti in buona fede, in altri casi perché volutamente falsificati). Il falso è comunque destinato a durare poco perché viene facilmente identificato quando i risultati non vengono verificati e confermati dalla comunità scientifica.

I rischi a mio avviso più subdoli e potenzialmente più gravi associati all’uso dell’IA non sono legati all’invenzione di pubblicazioni e dati completamente falsi, ma alle alterazioni – molto meno facilmente identificabili – che l’IA potrebbe introdurre nella conduzione degli esperimenti e nell’analisi dei dati sperimentali.

I sistemi tradizionali di analisi dei dati contengono generalmente un comando (che gli studenti di fisica chiamano maliziosamente “pulsante Millikan“) che consente di eliminare alcuni dei dati che vengono analizzati. Questo comando va utilizzato con prudenza e con estremo rigore, solo se c’è l’evidenza incontrovertibile che il dato che sarà eliminato è stato alterato da fattori esterni indipendenti dalla volontà dello sperimentatore.

Nel momento in cui l’analisi dei dati utilizza procedure sempre più complicate ed automatizzate c’è il rischio che il compito di “schiacciare il tasto Millikan” sia affidato alla decisione autonoma dell’IA. In questo modo lo sperimentatore riceve un prodotto finale di aspetto migliore (più accurato), ma se la scelta di escludere certi dati è stata fatta in modo errato il risultato potrebbe essere sbagliato. Il rischio c’è e non va mai dimenticato. Recentemente è successo che alcuni pacchetti di analisi dei dati utilizzati in taluni settori della biologia siano stati accusati di fornire risultati parzialmente sbagliati. Questo succede senza che lo sperimentatore intervenga personalmente: è il sistema che autonomamente fa le sue scelte e lo sperimentatore si limita a raccogliere i risultati finali.

L’antidoto contro un uso disinvolto del “tasto Millikan” da parte dell’IA c’è e consiste – ancora una volta – nella verifica sperimentale dei risultati da parte di altri ricercatori indipendenti. Questo può richiedere molto tempo, ma prima o poi accade.

C’è un terzo aspetto legato all’uso intensivo dell’IA in campo scientifico che, piuttosto che un rischio di utilizzo inappropriato, potremmo definire una perdita di opportunità. Molte importanti scoperte scientifiche sono state fatte in modo del tutto inaspettato (è quel fortunato meccanismo che gli inglesi chiamano serendipity).

L’utilizzo dell’IA nella gestione degli esperimenti rischia di “ingabbiare” l’attività dello sperimentatore riducendo drasticamente la probabilità di produrre scoperte inaspettate. Nel caso – rarissimo – che tali eventi si verifichino non è affatto detto che i sistemi di analisi dei dati basati sull’IA siano in grado di riconoscere una eventuale scoperta inattesa e non la confinino automaticamente tra gli errori da scartare.

Prima di utilizzare un sistema di acquisizione ed analisi dei dati sperimentali interamente affidato all’IA bisognerebbe validarlo sottoponendolo a quello che io chiamerei “il test della penicillina“. La scoperta della penicillina da parte di Alexander Fleming è forse l’esempio più noto di una scoperta scientifica completamente casuale ed inaspettata. Di fronte alla stessa situazione che scatenò la curiosità e l’intuito di Fleming cosa farebbe un sistema gestito dall’intelligenza artificiale?

In conclusione, l’intelligenza artificiale offre molte nuove opportunità agli scienziati aprendo la strada per lo sviluppo di esperimenti sempre più sofisticati. In particolare può essere molto utile per ridurre drasticamente i tempi ed i costi degli esperimenti e per analizzare dati sperimentali di grandissima dimensione. I sistemi di intelligenza artificiale sono ampiamente utilizzati anche per estrarre informazioni dagli archivi contenenti pubblicazioni ed altro materiale scientifico, liberando i ricercatori da incombenze ripetitive e poco produttive.

Il pericolo principale dell’IA è legato alla possibilità di generare dati sperimentali fasulli (inclusi i risultati del cosiddetto “cherry picking” che sono forse la forma più pericolosa di falso).

I metodi basati sull’IA battono qualsiasi forma di intelligenza umana se ci limitiamo a considerare la capacità di raccogliere e analizzare dati, ma – almeno fino ad oggi – non sono ancora realmente competitivi dal punto di vista della creatività e della capacità di esercitare la curiosità.

I bravi scienziati sono interessati ad indagare la Natura nei suoi diversi aspetti anche a costo – qualche volta – di “saltare di palo in frasca” entusiasmandosi per un risultato inaspettato anche se molto distante rispetto all’idea originale che aveva ispirato la loro ricerca. Fino a quando non disporremo di una vera e propria “curiosità artificiale” c’è ancora molto spazio per la curiosità e per l’intelligenza umana.

L’unico vero rischio – a mio avviso – è che prevalga la pigrizia e che gli esseri umani preferiscano delegare all’intelligenza artificiale una parte crescente delle loro decisioni. Per evitare che ciò avvenga è essenziale che tutti – soprattutto i più giovani – non rinuncino ad “addestrare” la loro intelligenza naturale.

Il piacere di imparare e la curiosità per tutto ciò che è nuovo sono gli elementi essenziali a cui non dovremo mai rinunciare.

Lascia un commento